Kausalität und Korrelation

6. Kausalität und Korrelation

Bisher haben wir nur einzelne Merkmale betrachtet. Jetzt wollen wir über mögliche Zusammenhänge zwischen zwei Merkmalen nachdenken. Natürlich besteht die hohe Kunst der statistischen Auswertung in der Analyse komplexer Zusammenhänge zwischen sehr vielen Merkmalen – aber wir wollen hier nicht die hohe Kunst der Statistik beschreiben, sondern nur die einfachen Zusammenhänge kennenlernen. Wenn wir diese verstanden haben, dann können wir die Zahl der zu analysierenden Merkmale beliebig erhöhen.

6.1 Korrelation

Beginnen wir mit einfachen quantitativen Merkmalen wie Größe und Gewicht. Es besteht die Möglichkeit, dass sich diese zwei Merkmale gleichartig zueinander verhalten. Betrachten wir dazu den Zusammenhang zwischen unserer Körpergröße und dem Körpergewicht. Wenn wir mit zunehmendem Lebensalter wachsen, dann nehmen wir logischerweise auch an Gewicht zu. Wenn wir die Körpergröße mit dem zugehörigen Körpergewicht von Personen als Wertepaare auf einer X- und Y-Achse auftragen, dann erhalten wir Punktwolken wie in Abbildung 6-1.

Abb. 6-1 Zwei Parameter mit einer positiven Korrelation

In beiden Punktwolken steigen beide Werte gleichsinnig an. In der rechten Abbildung ist der Zusammenhang sehr eng, weil die Werte fast alle auf einer Geraden liegen. Diese sehr enge Punktwolke weist daraufhin, dass die Werte sich sehr stark gegenseitig beeinflussen. Solch eine sehr enge, fast perfekte Kurve erwarten wir, wenn wir zum Beispiel die Größe und das Gewicht von Goldbarren auftragen. Häufiger sind allerdings Punktwolken wie auf der linken Seite, die nicht so eng verteilt sind wie bei der Größe und dem Gewicht von Personen. Wie erklären wir uns diese unterschiedlichen Verteilungen? Beim Gold gehen wir auf Grund des konstanten spezifischen Gewichtes von einer festen Beziehung zwischen Größe und Gewicht aus, so dass mit zunehmender Größe eines Goldbarrens das Gewicht in einem festen Verhältnis ansteigen muss. Anders verhält es sich bei dem Körpergewicht, denn es gibt bei derselben Körpergröße schlanke, normal- und übergewichtige Menschen. Da das Körpergewicht nicht nur von der Größe, sondern auch von anderen Lebensgewohnheiten und individuellen Eigenschaften abhängt, verteilt sich die Punktwolke zwangsläufig weiter.

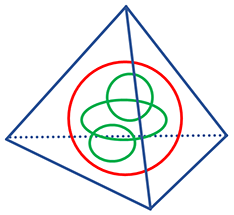

Abb. 6-2 Zwei Parameter mit einer positiven, keiner und einer negativen Korrelation

Bisher haben wir unterstellt, dass sich die Wertpaare X und Y gleichsinnig verhalten. In der Abb. 6-1 stiegen mit den Werten X (Größe) auch immer die Werte Y (Gewicht). Wenn sich die Werte in dieser Art und Weise proportional zueinander verhalten, wenn also X und Y gleichsinnig steigen, dann sprechen wir von einer positiven Korrelation (Abb. 6-2). Wenn kein Zusammenhang zwischen zwei Werten zu bestehen scheint, dann besteht keine Korrelation. Verhalten sich die beiden Werte aber umgekehrt proportional zueinander, dann sprechen wir von einer negativen Korrelation. In diesen Fällen steigt der X-Wert und der Y-Wert fällt.Mit einer geeigneten Software lässt sich auch die Stärke des Zusammenhanges berechnen. Wir sprechen dann hochtrabend von Korrelationskoeffizienten, die zwischen -1 und +1 betragen können. Bei -1 würde es sich um eine perfekte negative Korrelation, bei Null um überhaupt keine Korrelation und bei +1 um eine perfekte positive Korrelation handeln. Auch wenn solche Koeffizienten leicht berechnet werden können, können sie uns stark in die Irre führen. Die Berechnung hängt nämlich von vielen weiteren Annahmen über die Werte ab, die häufig nicht erfüllt sind. Wir erhalten im schlimmsten Fall Korrelationskoeffizienten mit Scheinkorrelationen.

Diese Scheinkorrelationen können auftreten, wenn wir zum Beispiel die korrelierten Wertepaare A und B betrachten, die sich aber nicht direkt gegenseitig, sondern über einen uns unbekannten dritten Wert C beeinflussen. Eine andere Ursache für Scheinkorrelationen sind Inhomogenitäten in den Daten. Da wir sie in den Abbildungen entlarven können, sollten wir uns die Abbildungen immer sehr sorgfältig anschauen. Wenn einzelne Werte stark abweichen oder vereinzelte Punktwolken auf Inhomogenitäten hinweisen, sind die Korrelationen fraglich.

Abb. 6-3 Falsch-positive Korrelation von nicht-korrelierten Daten wegen zweier Anhäufungen oder wegen eines einzigen Ausreißers

Fehlinterpretationen können wir vermeiden, wenn wir bereits vor der Berechnung möglicher Korrelationen begründen, wie die Parameter zusammenhängen könnten. Wenn wir die Zusammenhänge plausibel erklären können, dann beschäftigen wir uns seltener mit unsinnigen Zusammenhängen wie bei den Störchen und den Geburten. Als zweiten Schritt sollten wir die Graphiken analysieren und erst im dritten Schritt die statistische Analyse durchführen.

6.2 Kausalität

Wenn wir eine Korrelation feststellen, dann bedeutet das nicht zwangsläufig, dass sich die Werte gegenseitig direkt beeinflussen. Diese Verknüpfung zwischen den Parametern kann zufällig sein oder sie kann auf einer Ursache-Wirkung-Beziehung beruhen. Wenn wir eine kausale Beziehung vermuten, dann benötigen wir gute und plausible Gründe, denn aus den einzelnen Daten allein ist sie nicht erkenntlich.

Werfen wir einen kurzen Blick auf unser Kausalitätsverständnis. Das Kausalitätsprinzip ist für uns ein äußerst wichtiges und erfolgreiches Denkschema. Wir sind gewohnt, im Alltag nach Gründen oder Ursachen zu suchen, um die Welt in ihren Zusammenhängen zu verstehen. Wenn wir die Ursachen oder Gründe einer Wirkung kennen, dann verstehen wir sie, können sie verlässlich vorhersagen und somit auch technisch beherrschen. Die Kausalitätsbeziehung ist für unser technisches Weltverständnis unabdingbar.Was ist aber die Kausalität? Was meinen wir mit „Ursache-Wirkung-Beziehung“? Letztere wird häufig durch einfache Beispiele wie beim Billiardspiel erklärt. Wenn wir dort eine Kugel mit dem Queue anstoßen, dann rollt die zuerst angestoßene Kugel auf eine andere Kugel zu und stößt sie an. Dieser Stoß oder Impuls ist die Ursache dafür, dass die zweite Kugel anfängt, sich zu bewegen. Der Stoß der ersten Kugel ist die Ursache für die Bewegung der zweiten Kugel. Obgleich dieses einfache Beispiel die Kausalität als Ursache-Wirkung-Prinzip ausreichend erläutert, offenbart sie zugleich ein Problem. Die Kausalität ist keine eigenständige Beziehung, die wir direkt beobachten können. Wir können nur beobachten, wie zwei Ereignisse immer und immer wieder nacheinander eintreten. Und aufgrund der wiederholten Ereignisse schließen wir auf eine Ursache-Wirkung-Beziehung. Diese nicht-beobachtbare Verknüpfung von Ereignissen zu einer Ursache-Wirkung-Beziehung ist aber fehleranfällig. Wir wissen nicht, ob die Wirkung tatsächlich durch die von uns vermutete Ursache bewirkt wurde, oder ob es sich um eine zufällige Verknüpfung handelt.

Der wohl älteste und berühmteste Irrtum ist Thales von Milet zuzuschreiben, der als Vater der modernen westlichen Denkweise gilt, weil er als erster ein systematisches Denken in Kausalitäten forderte. Bei seinen Besuchen Ägyptens suchte Thales nach der Ursache für die jährlichen Nilüberschwemmungen. Er glaubte sie in den sehr starken Winden gefunden zu haben, die aus Norden kommend das Wasser in den Nil drücken und somit das Wasser stauen. Seine Erklärung ist falsch, wie wir heute wissen. Die starken Passatwinde aus dem Norden führen zu massiven Regenfällen im Quellgebiet des Nils und verursachen dadurch die Nilüberschwemmung. Die Ursache „Passatwinde“ wurde von Thales zwar korrekt vermutet, aber die Ursache-Wirkung-Beziehung hatte er nicht richtig erkannt. Es ist für eine korrekte Kausalitätsbeziehung nicht ausreichend, dass wir eine Assoziation herstellen zwischen Ereignissen, die zufällig gleichzeitig auftreten. Wir erwarten mehr. Wir erwarten eine enge abhängige Beziehung. Da wir diese aber nicht beobachten können, können wir nur aus sie schließen und dabei können wir uns irren.

Als Anekdote über die falsche Schlussfolgerung von einer Korrelation auf Ursachen wird immer wieder das Storchenbeispiel angeführt. Nach dem zweiten Weltkrieg wurde ein Rückgang der Geburten festgestellt. Zugleich bemerkte man, dass immer weniger Storchennester besetzt waren. Aus diesen beiden Veränderungen, die zufällig gleichzeitig auftraten, hätten kleine Kinder sehr gut eine kausale Beziehung ableiten können. Ob tatsächlich eine kausale Beziehung denkbar ist, lässt sich niemals aus den Daten allein ableiten. Wir wollen hier auch nicht verhehlen, dass der Begriff „Ursache“ ebenfalls problematisch ist. Was ist eine hinreichende Ursache für ein Ereignis? Wie können wir herausfinden, welches die genauen Ursachen für ein Ereignis sind? Diese Fragen sind äußerst schwierig zu beantworten und heute wird von vielen der Ansatz von David Lewis als pragmatisch geeignet angesehen. Lewis geht von sogenannten kontrafaktischen Implikationen aus wie: „Hätten Kängurus keine Schwänze, würden sie umfallen“. Offensichtlich sind die Schwänze die Ursache dafür, dass ein Känguruh nicht umfällt. Wenn wir also kontrafaktische Aussagen aufstellen und sie auf ihre Wahrheit überprüfen, dann können wir aus der Verneinung auf die Ursache schließen: „Hätte das Känguruh keinen Schwanz, dann würde es umfallen.“

6.3 Regression

Wenn wir Wertepaare finden, die gut miteinander korrelieren, dann belassen wir es nicht bei dieser Aussage. Wir wollen dann mehr erreichen.

Abb. 6-4 Korrelation von zwei Parametern mit linearen Regressionskurven

Wir wollen dann versuchen, aus einem Wert, den anderen herzuleiten. Wenn wir eine enge Korrelation zwischen Goldbarrengröße und Gewicht haben, dann können wir für beliebige Barrengrößen das Gewicht vorhersagen, und umgekehrt. Wir unterstellen dabei eine strikt lineare Beziehung, die sich mathematisch durch eine Gerade darstellen lässt (Abb. 6-4). Wir werden deshalb durch unsere Punktwolke eine Gerade ziehen. Diese Linie, die auch Regressionskurve genannt wird, soll die gesamte Punktwolke mathematisch repräsentieren. Bei einer sehr engen Punktwolke ist das deutlicher als bei einer weiter verteilten Punktwolke.

Abb. 6-5 Nicht-lineare Korrelationen

Wir sehen aber nicht immer nur lineare Zusammenhänge, sondern manchmal verteilen sich die Punktwolken derartig, dass wir eine gebogene Kurve als repräsentativ ansehen (Abb. 6-5). Auch hier gilt, dass wir uns die Punktwolken zunächst ansehen sollten, um dann eine geeignete Kurve auszuwählen. Um es noch einmal zu betonen: wir benötigen die Regressionskurven, um aus einzelnen Werten andere vorherzusagen. Diese Vorhersage kann nur bei Werten zutreffen, die gut miteinander korreliert sind. Wenn wir versuchen wollten, das Körpergewicht vorherzusagen, indem wir die Körpergröße angeben, dann ist zwar eine Vorhersage möglich, aber sie wird sehr ungenau sein. Je weiter die einzelnen Punkte von der Geraden abweichen, umso unpräziser wird die Vorhersage.